Беспилотное будущее — будущее без человека?

Развитие технологий нейронных сетей может начать частично вытеснять из-за руля людей уже в ближайшие годы, а если прогресс будет идти хотя бы с той же скоростью, что и сейчас, то через 10 лет встанет вопрос, а нужен ли вообще водитель или уже нет?

Компьютерное зрение развивается прямо на глазах, машины учатся видеть и делают это уже сегодня, зачастую, лучше, чем средний человек. Это дает возможность создавать сложные технические системы, основанные на этой технологии. Машина оценивает ситуацию с частотой, недостижимой для человека, замечает детали, которые человек не может заметить физически из-за ограничений органов чувств. То есть потенциально способна превзойти любого человека в части управления автомобилем в любых условиях. Однако, как обычно, есть большой нюанс.

Сейчас, когда автомобиль находится под управлением человека, в случае ДТП, даже смертельных, почти всегда есть конкретный виновник. Это регулирует различные аспекты трагического инцидента и не наносит родным погибшего моральных увечий. Виновник получает заслуженное наказание, тюремный срок, выплачивает различные денежные компенсации и сам этот факт является смягчающим фактором для тех, кто потерял своего родного человека.

В случае, когда автомобилем будет управлять специально обученная нейронная сеть, становится совершенно непонятным, кто должен нести ответственность за инциденты с погибшими или ранеными? Искусственный интеллект не субъектен, поэтому судить чип или плату с этими чипами чисто физически невозможно. Судить разработчика? Он тоже не причем, ведь остальные 100 тысяч копий успешно ездят. Судить того, кто обучал ИИ? Таких людей может быть очень много, не один десяток. Чья ошибка при обучении стала роковой уже узнать невозможно, да и не нужно. Получается, что в случае причинения смерти человеку со стороны беспилотного автомобиля отвечать будет… никто. Точнее, отвечать будет страховая компания, которая будет выплачивать компенсацию. Насколько это морально приемлемо, предлагаю подумать читателям самостоятельно.

Разумеется, разработчики подобных систем заявляют, что общая аварийность снизится и количество жертв в автомобильных авариях будет кратно меньше, чем есть сейчас. Однако за этими цифрами, пусть даже и меньшими относительно сегодняшних, прячется очень тяжелый вопрос: пусть в авариях беспилотников погибли 100 человек, а не 1000 человек, как сегодня. Но почему за смерть этих людей никто не ответил, кроме страховой? Почему?

Ответ на этот вопрос дал Григорий Бакунов из Яндекса, процитирую: «Рано или поздно с приходом алгоритмов человечество будет вынуждено отказаться от морали.» Действительно, зачем заморачиваться моральными дилеммами и «проблемой вагонетки», спрашивать, кого спасать в аварии: пожилого пассажира беспилотника или маленького мальчика, выехавшего на дорогу на велосипеде? Когда можно просто отказаться от морали и математически рассчитать, кем более выгодно пожертвовать?

Однако, пока потребитель голосует рублем, долларом или евро, он будет требовать приоритета в обеспечении именно его безопасности, даже если он дряхлый и больной старик, нежели чем безопасность и даже жизнь маленького ребенка. Если такая безопасность не будет обеспечена, то никто, находясь в здравом уме и трезвой памяти, такой автомобиль не купит и пользоваться им не будет.

Это логично, потому что у людей есть инстинкт самосохранения, а вот у машин его (пока) нет. Следовательно, как машина будет запрограммирована (обучена), так она и будет себя вести в сложной дорожной ситуации. Пожертвовать собой для неё ровным счетом ничего не значит, равно как и пожертвовать ребенком или собственным пассажиром. Ничего личного, только бизнес весовые коэффициенты.

В Германии, где тоже идет подобная дискуссия, уже ответили на этот вопрос, чем вызвали шквал критики со стороны прогрессивной общественности. Спасать немцы в первую очередь предложили пассажиров беспилотного авто. То есть самоуправляемый автомобиль будет делать всё, для того, чтобы спасти тех, кто находится внутри него. При этом, разумеется, машина не будет брать в расчет возможно кратно большее число жертв при попытке спасти именно пассажиров в нештатной ситуации. Критики подобной идеи упоминают гипотетические ситуации, когда автомобиль, спасая одного пассажира, может убить или покалечить целую группу детей из детского сада. Такая критика действительно заслуживает внимания.

На сегодняшний день у человечества нет ответа на этот вопрос, чью жизнь спасать? Самое известное исследование на эту тему провел Edmond Awad и его коллеги, которые создали экспериментальную «Моральную машину». В ходе этого замечательного научного исследования, которое удостоилось печати в Nature, они изучили мнение почти 40 миллионов человек из 233 «стран и территорий» (как они сами написали в статье). Авторы пришли к неожиданному выводу, что в различных обществах люди ожидают от машины разных моральных решений. Они открыли, что существуют три группы стран, в которых этика и мораль серьезно, если не радикально, отличаются друг от друга и эти различия коррелируют с коренными культурными чертами народов, в этих странах проживающих. Но самое главное в другом.

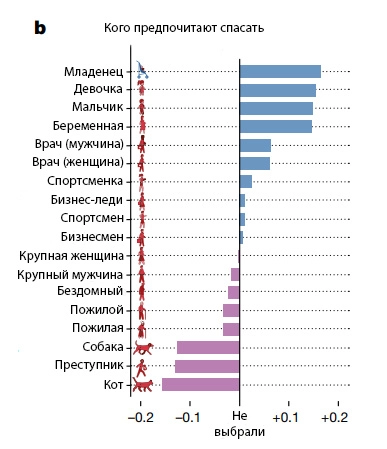

Суть эксперимента заключалась в моральном противопоставлении «спасать человека или животное?», «спасать пассажира или пешехода?», «спасать больше жизней или меньше жизней?», «спасать мужчин или женщин?» и так далее. Всего участникам эксперимента были предложены 13 подобных моральных дилемм и было предложено сделать выбор, кого спасать. Результаты на графике из оригинальной статьи:

То есть, больше всего людей предпочли бы, чтобы машина спасла жизнь младенца, пожертвовав жизнью кота или преступника. Кстати, жизнь преступника оказалась менее ценной, чем жизнь собаки, в глазах опрошенных, эта тема в статье не раскрывается, хотя достойна отдельного исследования.

Выяснилось, что машина должна вести себя по-разному в зависимости от того культурного кластера, в котором она находится:

Например, в западном моральном кластере, куда попала и наша страна, предпочитают просто положиться на волю случая (preference for inaction), а на худой конец люди желают, чтобы она спасала больше молодых человеческих жизней, что не оставляет шансов пожилому пассажиру-пенсионеру, которому не повезло встретиться с группой молодых спортсменов-бегунов, нарушающих ПДД. В то же самое время в восточном кластере (наиболее характерные представители Иран, Египет, Китай, Южная Корея, Малайзия, Япония) предпочли бы, если бы машина спасала законопослушных пешеходов. В южном моральном кластере (Аргентина, Монголия, Франция, Чехия, Алжир) предпочли бы спасти молодых успешных и красивых женщин и ни в коем случае не полагаться на случайность в выборе того, кому следует погибнуть в ДТП.

В итоге, в попытке ответить на прикладные вопросы, как авторы исследования, так и я, автор этой статьи, пришли к выводу, что машину надо обучать не только вождению, но и морали. Машинная мораль должна появиться и она будет отличаться в зависимости от того общества, в котором данная машина живет. Не стоит удивляться, что в южном культурном кластере вместо человека машина может спасти котика, в восточном убить десять детей из группы в детском саду, а в западном просто положиться на волю волн. И для каждого культурного кластера это будет вполне нормально и допустимо. Разумеется, что обучение машины морали — это сложный и пока не изученный сегмент, вызов для всего нашего общества и даже цивилизации.

Однако, есть и вторая, радикальная точка зрения сотрудника компании Яндекс, который предлагает вовсе отказаться от морали для упрощения технического прогресса. Действительно, зачем заморачиваться, зачем оставаться человеком, если самому можно стать машиной, только биологической? Просто отбросить всё человеческое и как просто всё становится!

Какая точка зрения победит, сделать человечной машину или сделать из человека машину, мы с вами узнаем уже совсем скоро.

Опубликовано 24.07.2020